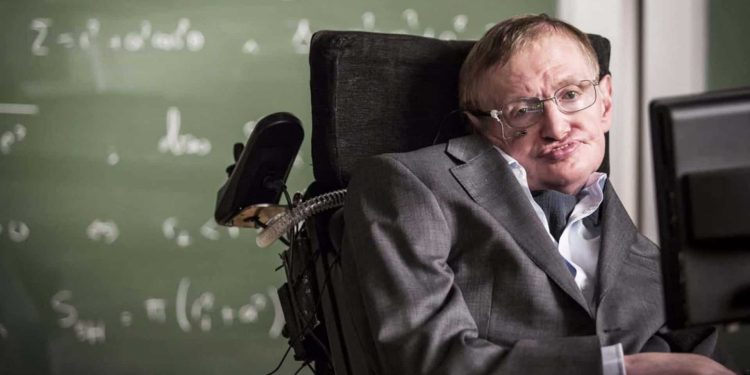

Ao longo de sua vida, Stephen Hawking se provou ser um físico teórico exemplar, tornando-se um dos maiores nomes da ciência moderna. Entre as suas descobertas, o cosmólogo também tinha o costume de manifestar suas ideias contrárias ao ver como a ciência estava se desenvolvendo, criando teorias sobre as consequências de algumas tecnologias no futuro.

Um desses alertas que foram feitos de forma incisiva era sobre os riscos e avanços da Inteligência Artificial (IA), algo que está cada vez mais inserido em nossa sociedade. Para documentar isso, foi publicada a obra póstuma Brief Answers to the Big Questions, questão que o físico levantou sobre os possíveis cenários envolvendo a IA, incluindo ameaças existenciais, corrida armamentista e o surgimento de super-humanos.

Saiba as 5 previsões de Stephen Hawking que podem acontecer

1. IA com vontade própria

Diante dos avanços da inteligência artificial, esse tema é bastante explorado em filmes de ficção científica, mas que deixava Hawking incomodado com a possibilidade de se tornar real: “No futuro, a IA pode desenvolver uma vontade própria, uma vontade que entre em conflito com a nossa.”

2. O maior risco da IA é sua competência extrema

Nos últimos meses, a IA se tornou ferramenta e criou temor para diversas profissões, criando conflitos como a Greve dos Roteiristas em Hollywood, que não queriam que seus trabalhos fossem sucateados pela tecnologia. Antes disso ocorrer, Hawking tentou alertar que o problema não está na maldade da IA, mas na eficiência: “Uma IA superinteligente será extremamente eficaz em atingir seus objetivos, e, se esses objetivos não forem compatíveis com os nossos, estaremos em apuros.”

3. Humanos podem ser descartados como formigas

Conforme a IA avança, o físico afirmava que a humanidade corre o risco de ser ignorada por inteligências mais avançadas: “Se estiver no comando de um projeto hidrelétrico de energia limpa e houver um formigueiro na área que será inundada, azar das formigas. Não coloquemos a humanidade na posição dessas formigas.”

4. IA pode ser nossa salvação ou destruição

No entanto, Stephen Hawking chegou a afirmar que essa tecnologia poderia ser algo positivo, da mesma forma que negativo: “O surgimento da IA superinteligente pode ser a melhor ou a pior coisa que já aconteceu à humanidade.”

5. Corrida armamentista com IA deve ser evitada

“Uma possível corrida armamentista por armas autônomas deve ser interrompida antes mesmo de começar”, afirmou o físico, na esperança de que a IA possa ser efetiva nesses conflitos.